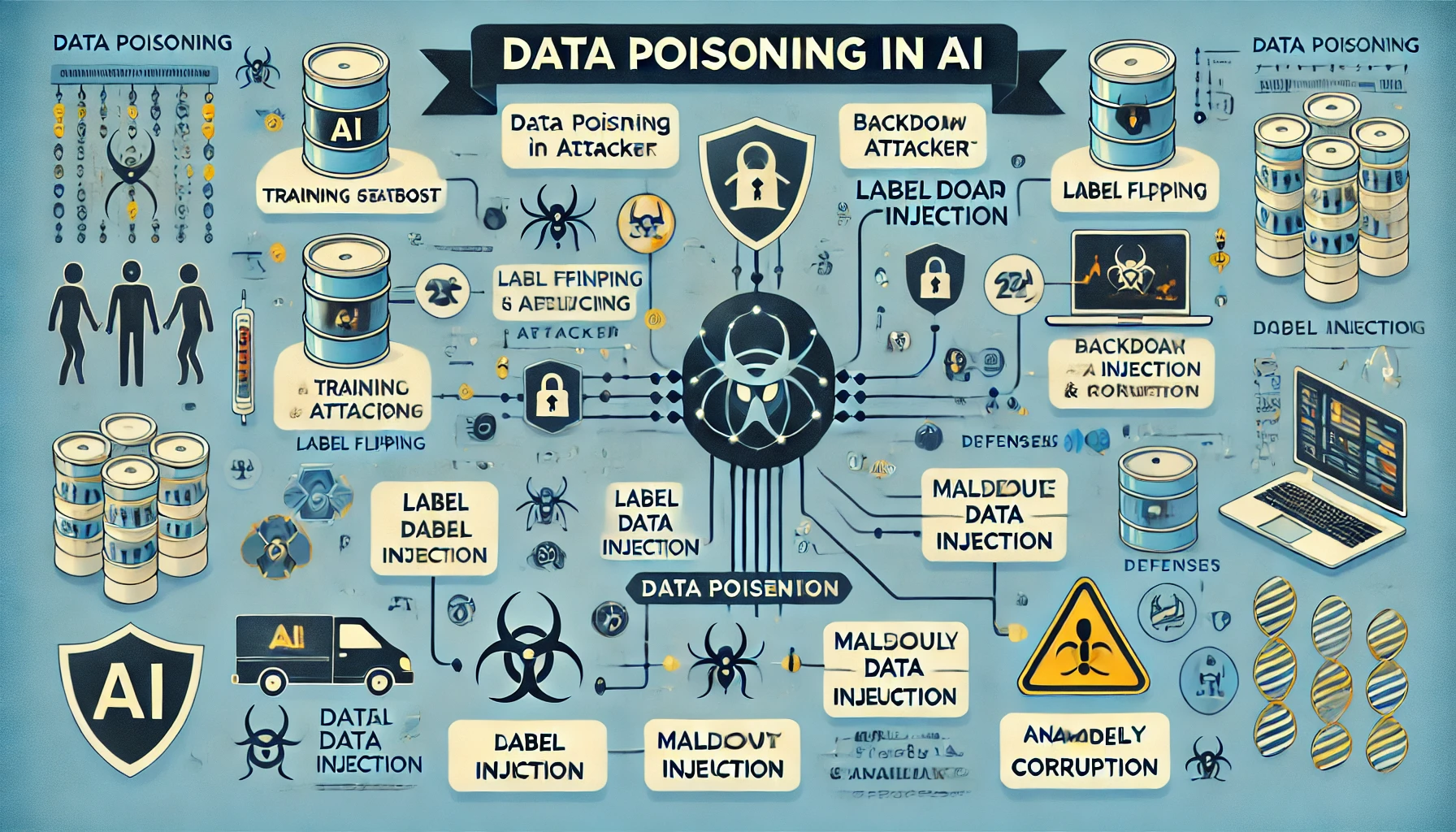

개요데이터 오염 공격(Data Poisoning Attack)은 인공지능 모델의 학습 단계에서 고의적으로 왜곡된 데이터를 주입해 모델의 예측 정확도나 의사결정을 교란시키는 공격 기법입니다. 이는 AI의 '학습 기반 의존성'을 악용한 전략으로, 보안·금융·의료 등 고신뢰 AI가 요구되는 분야에서 AI 시스템의 무결성과 안전성을 위협하는 치명적 위협으로 떠오르고 있습니다. 본 글에서는 데이터 오염 공격의 개념, 유형, 실제 사례, 탐지 및 대응 전략을 정리합니다.1. 개념 및 정의 구분 설명 데이터 오염 공격학습 데이터에 악의적 샘플을 삽입해 AI 모델의 학습 결과에 악영향을 주는 공격공격 대상지도 학습(Classification), 비지도 학습(Clustering), 강화학습 등공격 목적예측 정확도 저하..